前言

本文搜集了一些开源的基于LLM的RAG(Retrieval-Augmented Generation)框架,旨在吸纳业界最新的RAG应用方法与思路。如有错误或者意见可以提出,同时也欢迎大家把自己常用而这里未列出的框架贡献出来,感谢~

RAG应用框架

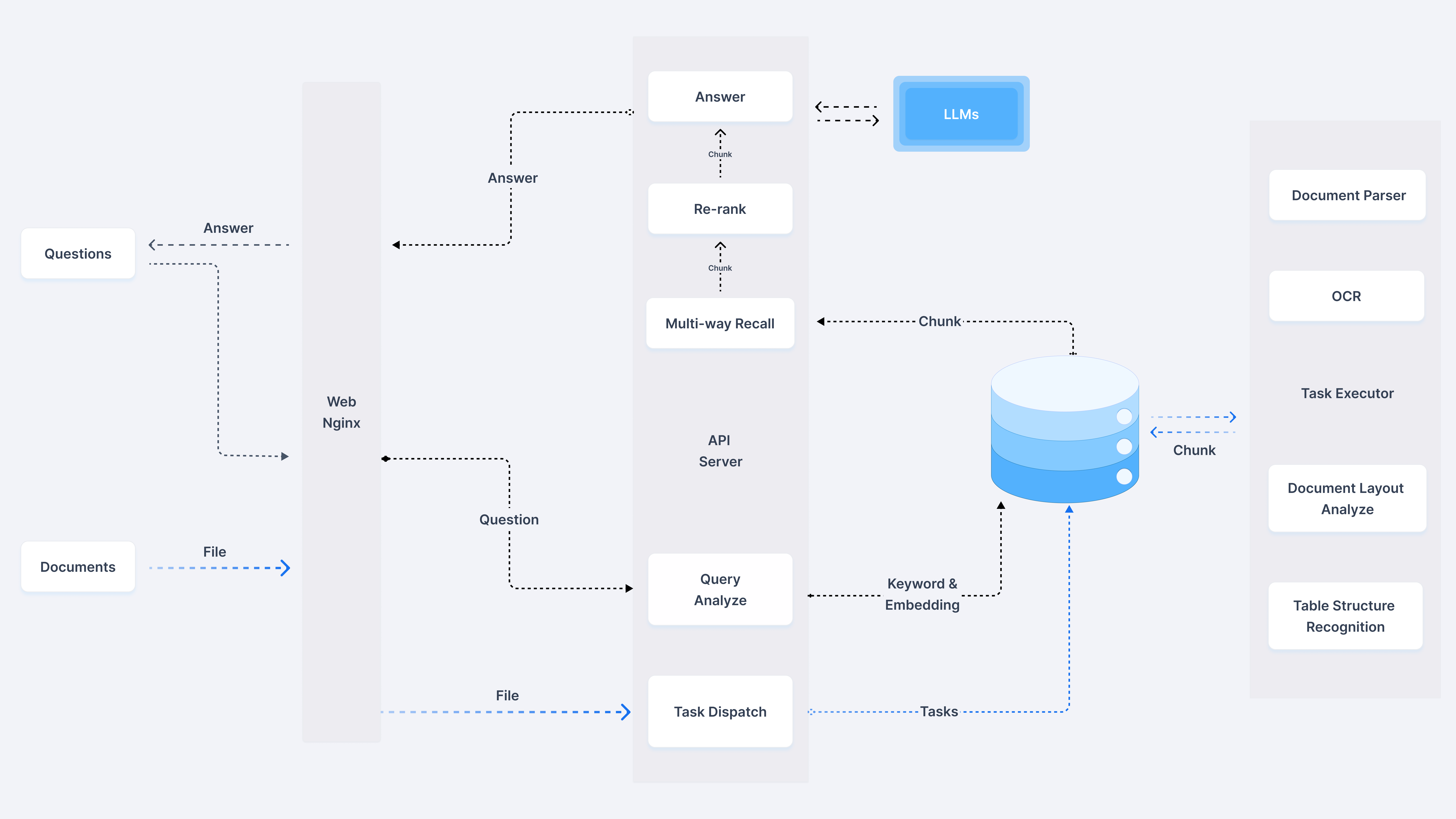

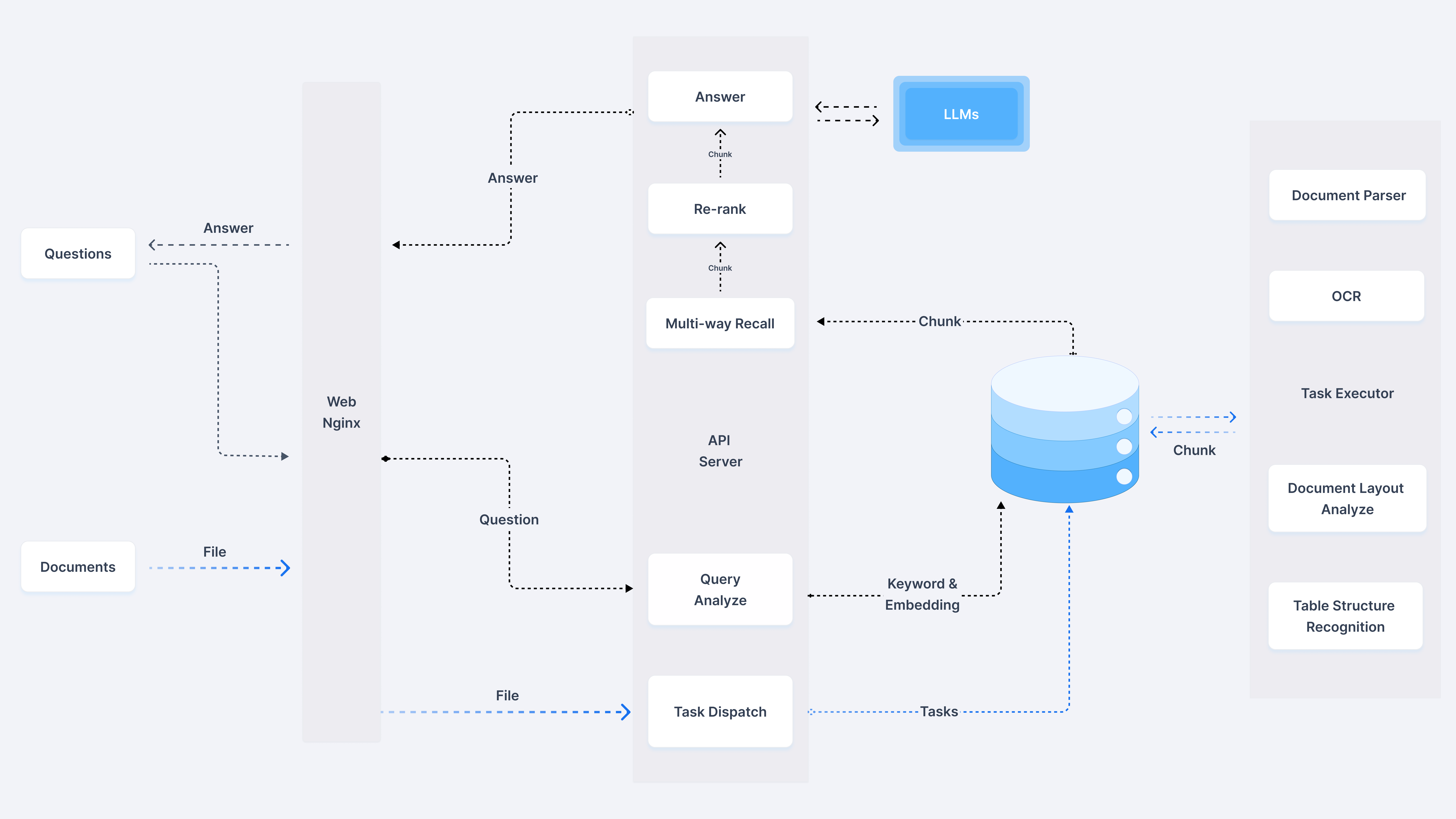

- RAGFlow

-

简介:RAGFlow 是一款基于深度文档理解构建的开源 RAG(Retrieval-Augmented Generation)引擎。RAGFlow 可以为各种规模的企业及个人提供一套精简的 RAG 工作流程,结合大语言模型(LLM)针对用户各类不同的复杂格式数据提供可靠的问答以及有理有据的引用。

-

特性:OCR、内置多种文档切分模板、文档切分可视化并且可修改、兼容多种文档数据类型

-

架构:

-

硬件要求:CPU >= 4 核、RAM >= 16 GB、Disk >= 50 GB、Docker >= 24.0.0 & Docker Compose >= v2.26.1

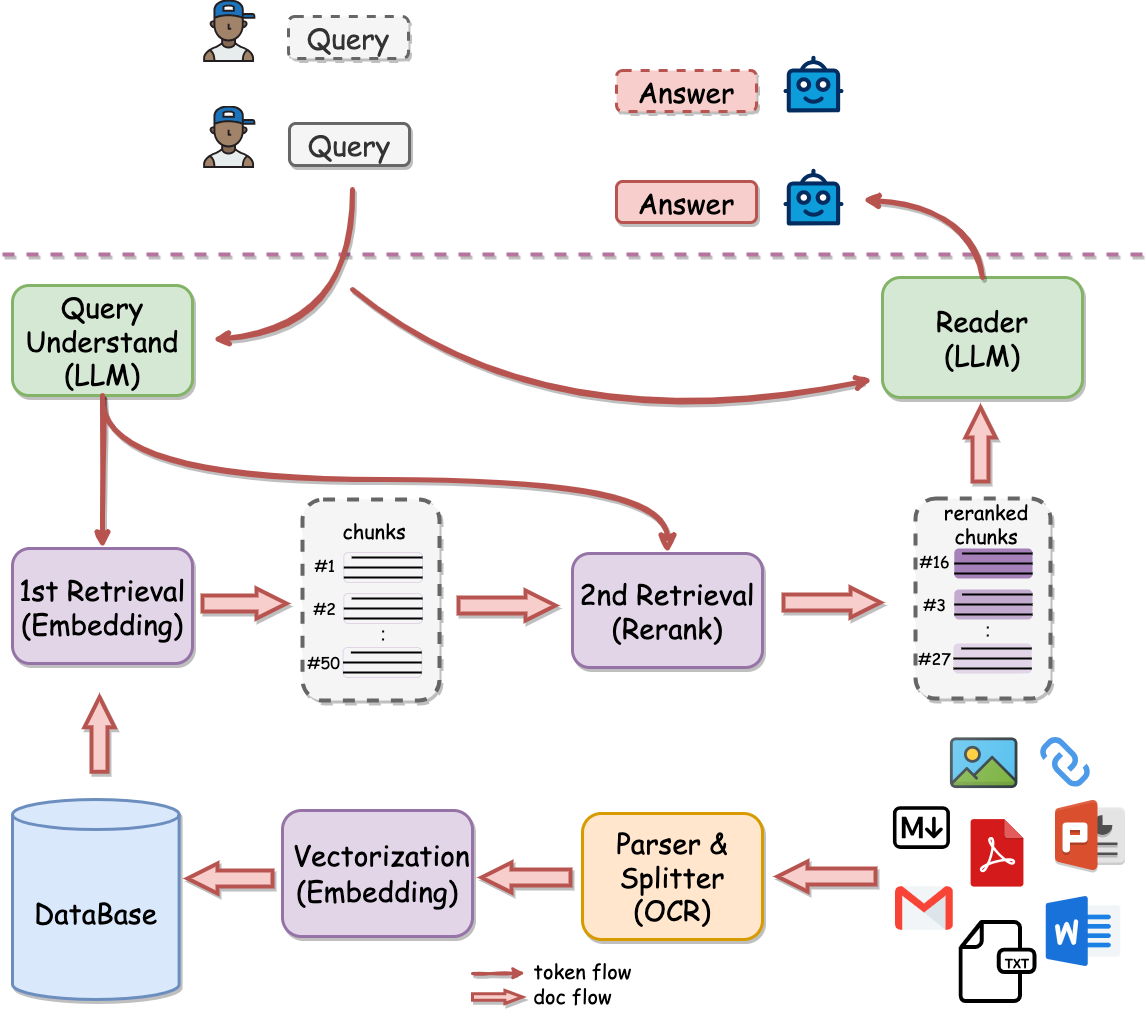

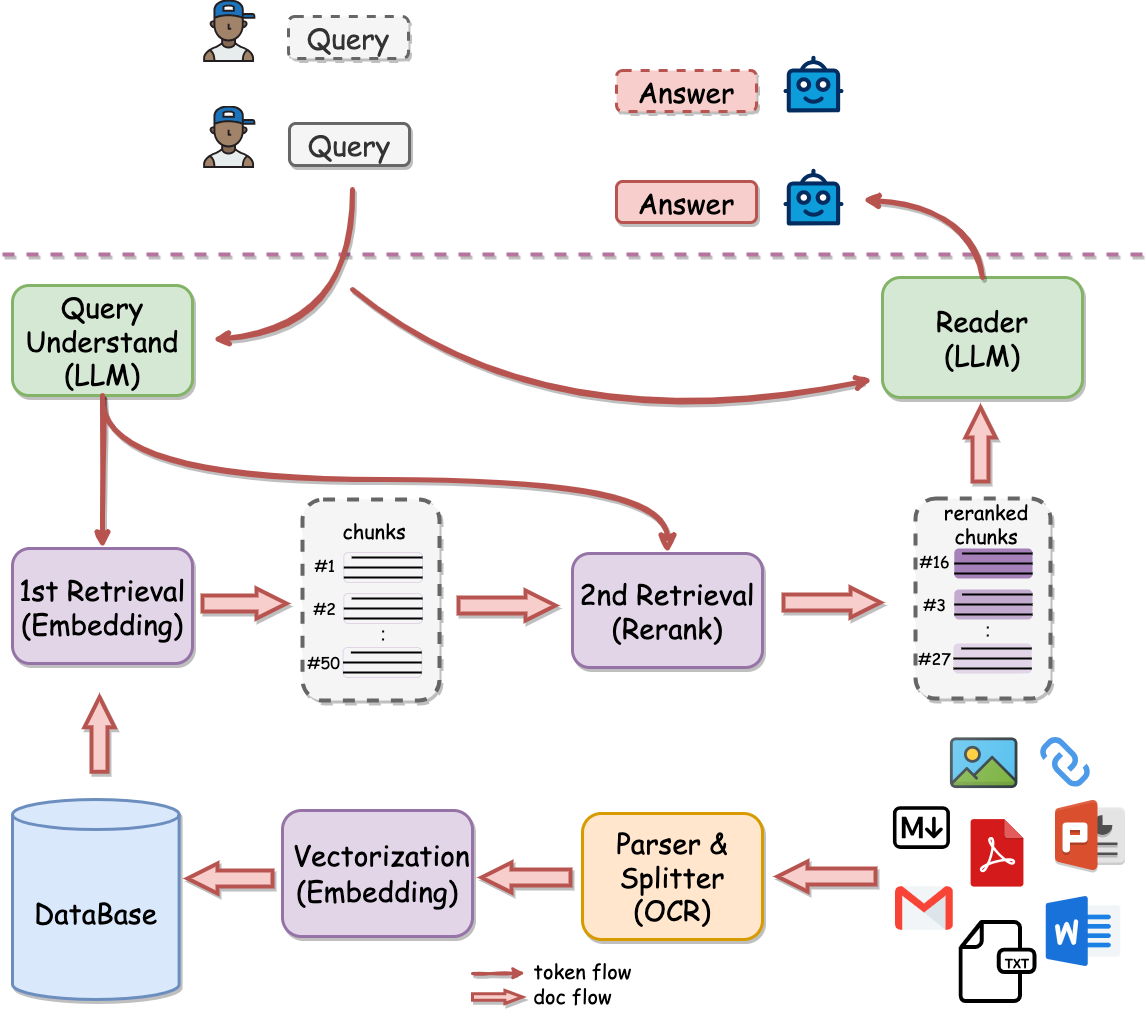

- QAnything

-

简介:QAnything ( Q uestion based on Anything ) 是贡献支持任何格式文件或数据库的本地知识库问答系统,可断网安装使用。您的任何格式的本地文件都可以往里扔,即可获得准确、快速、靠谱的问答体验。

-

特性:支持离线安装使用、跨语种问答、粗排和精排的二阶段召回

-

架构:

-

硬件要求:最低CPU即可;使用GPU环境需要NVIDIA GPU Memory >= 4GB (use OpenAI API) & Docker Desktop >= 4.26.1(131620)

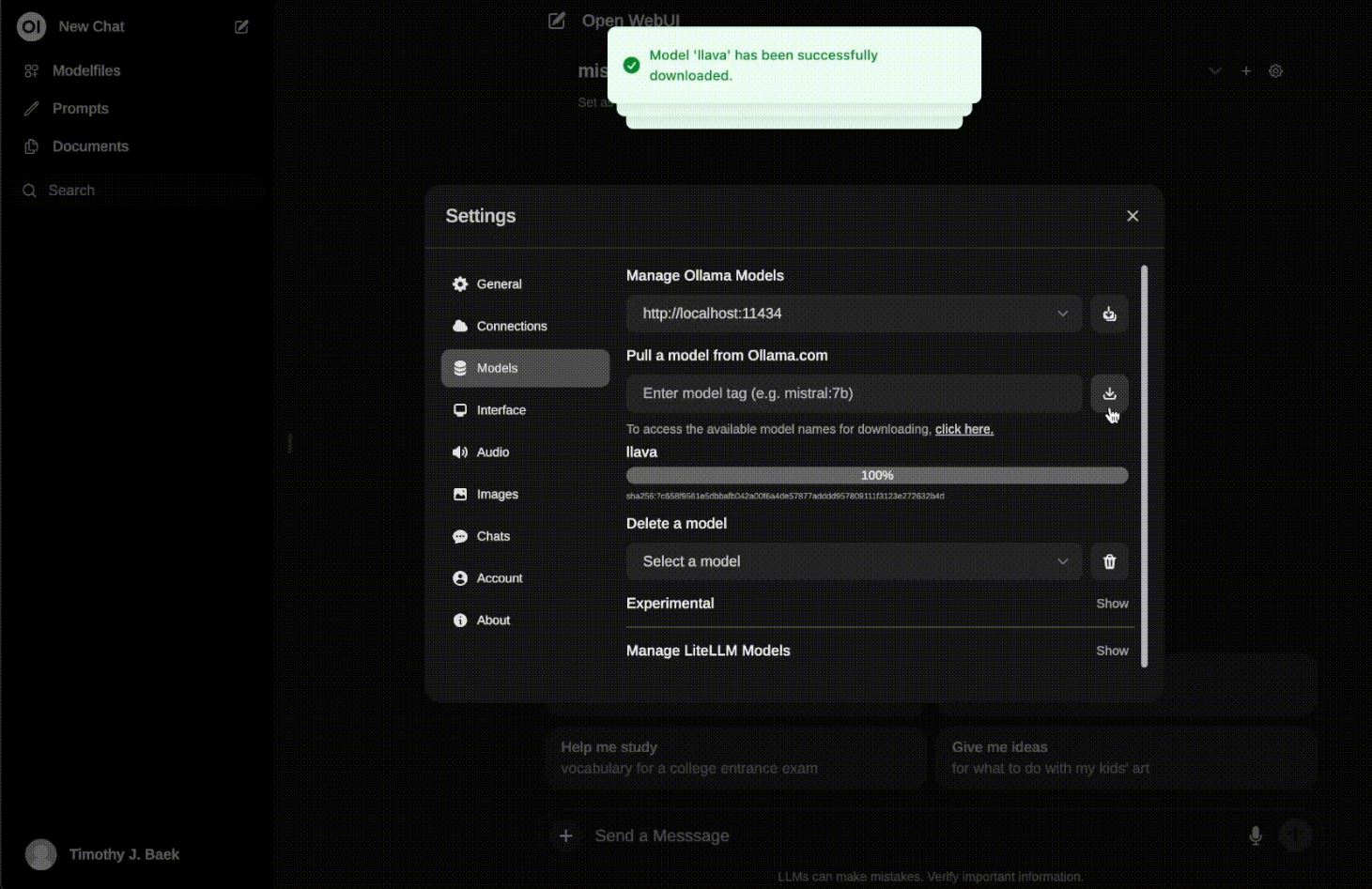

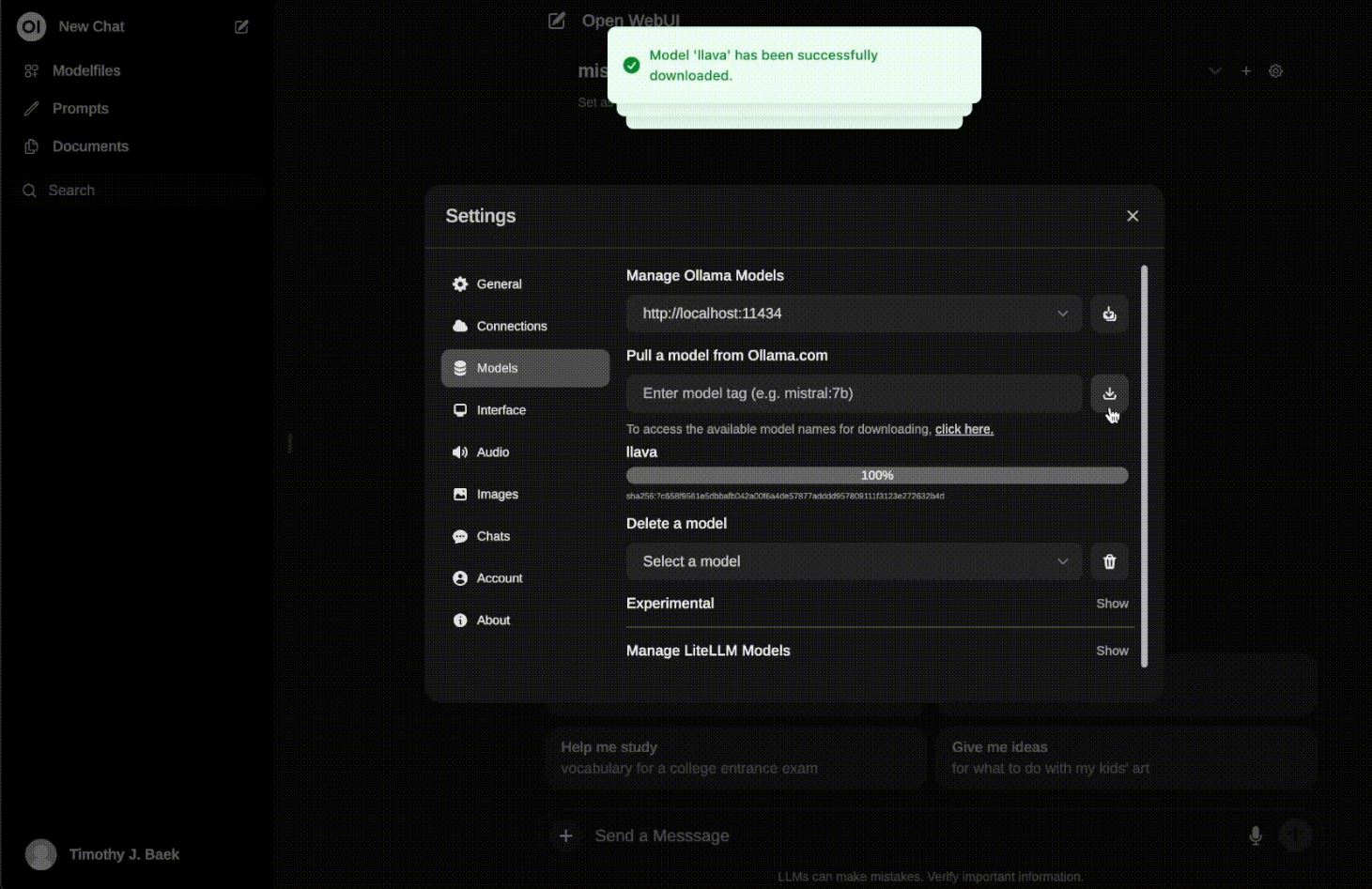

- open-webui

-

简介:Open WebUI 是一个可扩展、功能丰富且用户友好的自托管 WebUI,旨在完全离线操作。它支持各种 LLM 运行程序,包括 Ollama 和 OpenAI 兼容的 API。

-

特性:原生支持Ollama、支持安装和卸载模型、支持多模态模型、支持切换模型、多用户管理

-

架构:

-

硬件要求:最低CPU即可,使用GPU环境需要NVIDIA GPU Memory >= 4GB (取决于使用Ollama的模型大小)

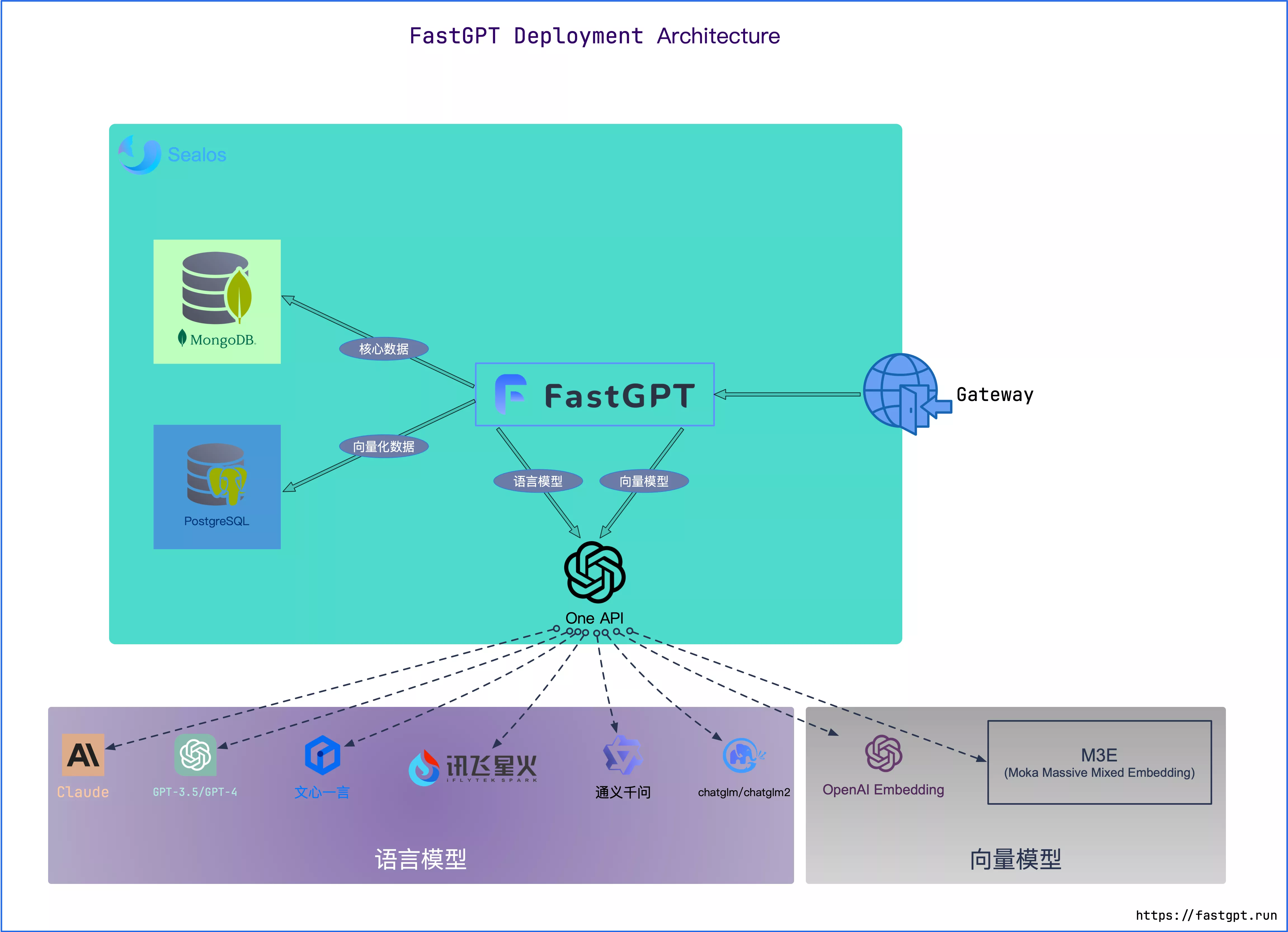

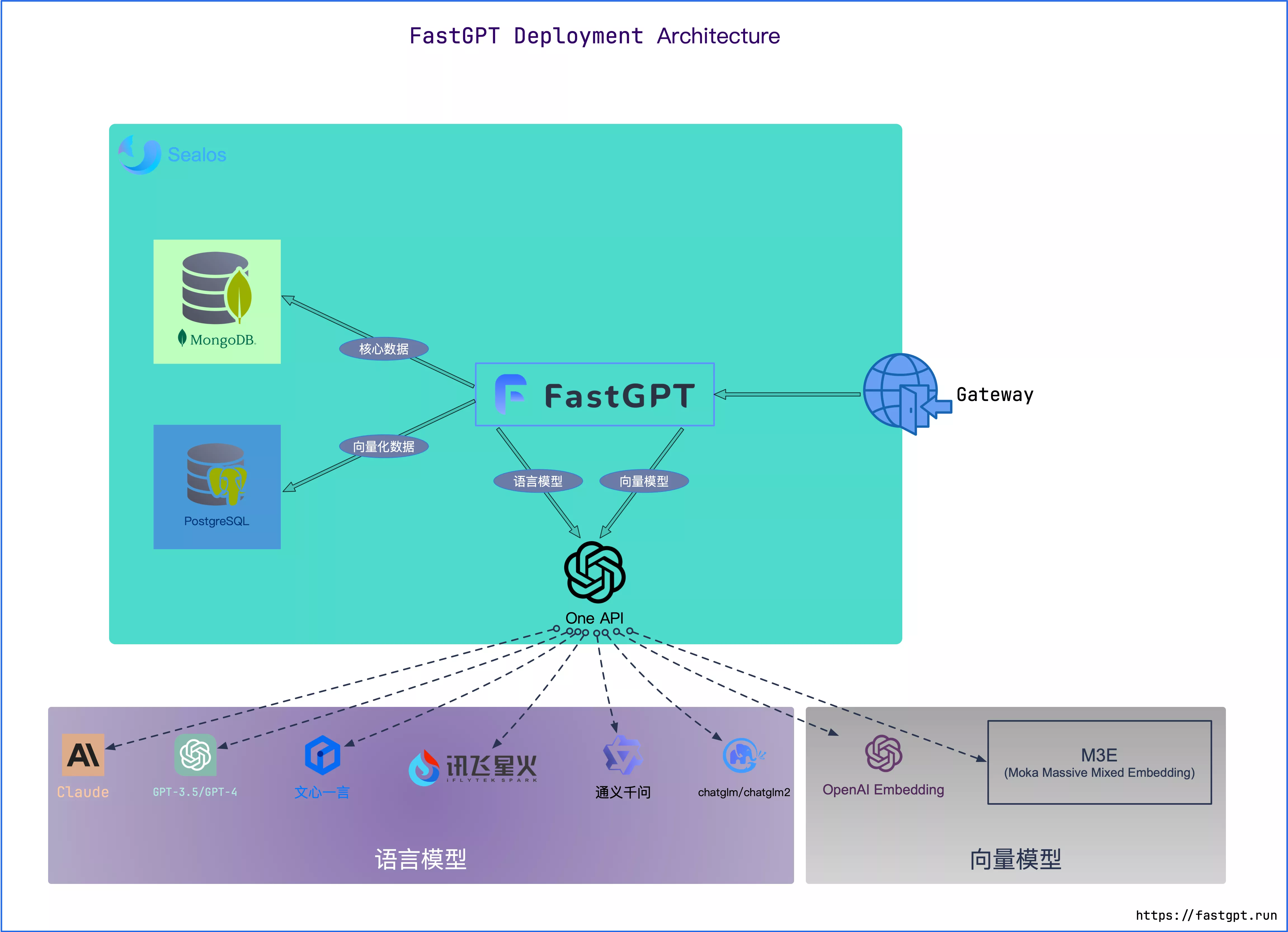

- FastGPT

-

简介:FastGPT 是一个基于 LLM 大语言模型的知识库问答系统,提供开箱即用的数据处理、模型调用等能力。同时可以通过 Flow 可视化进行工作流编排,从而实现复杂的问答场景!

-

特性:支持应用编排、免登录分享、支持接入飞书、企业微信等应用

-

架构:

-

硬件要求:CPU >= 2 核、RAM >= 4 GB用于安装数据库,GPU取决于使用的模型

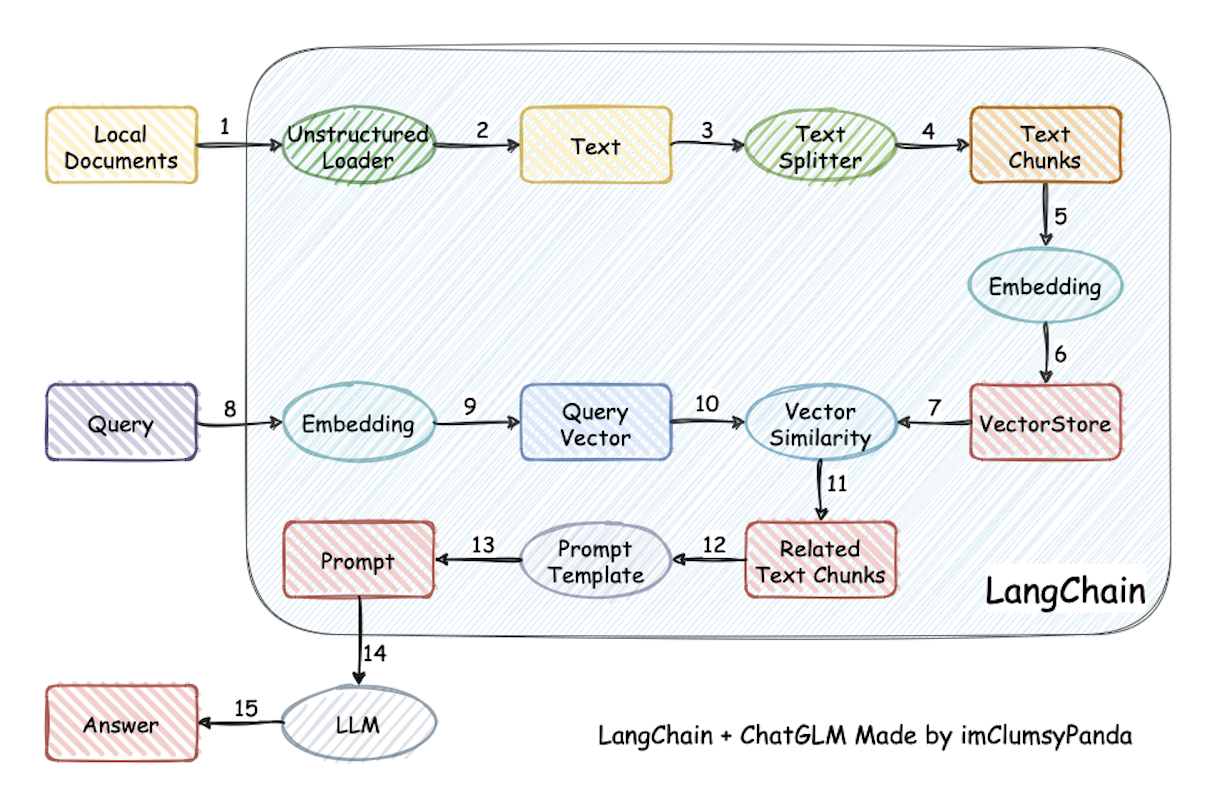

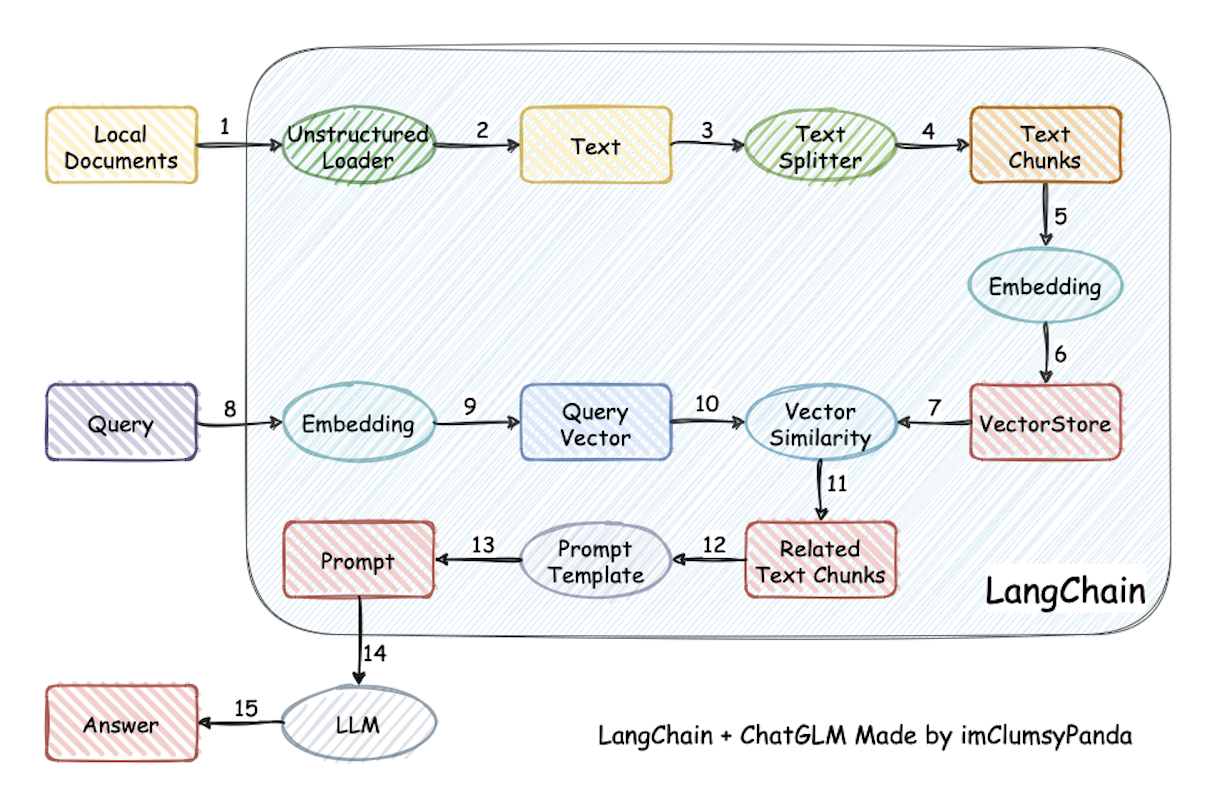

- Langchain-Chatchat

-

简介:基于 ChatGLM 等大语言模型与 Langchain 等应用框架实现,开源、可离线部署的检索增强生成(RAG)大模型知识库项目。

-

特性:算是比较早期的RAG框架了,使用的基本全是python的框架。该项目是一个可以实现完全本地化推理的知识库增强方案, 重点解决数据安全保护,私域化部署的企业痛点。支持市面上主流的本地大语言模型和Embedding模型,支持开源的本地向量数据库。 本开源方案采用Apache License,可以免费商用,无需付费。

-

架构:

-

硬件要求:对GPU要求较高